人工智能综合教学实验平台

一、设备介绍

1、平台简介

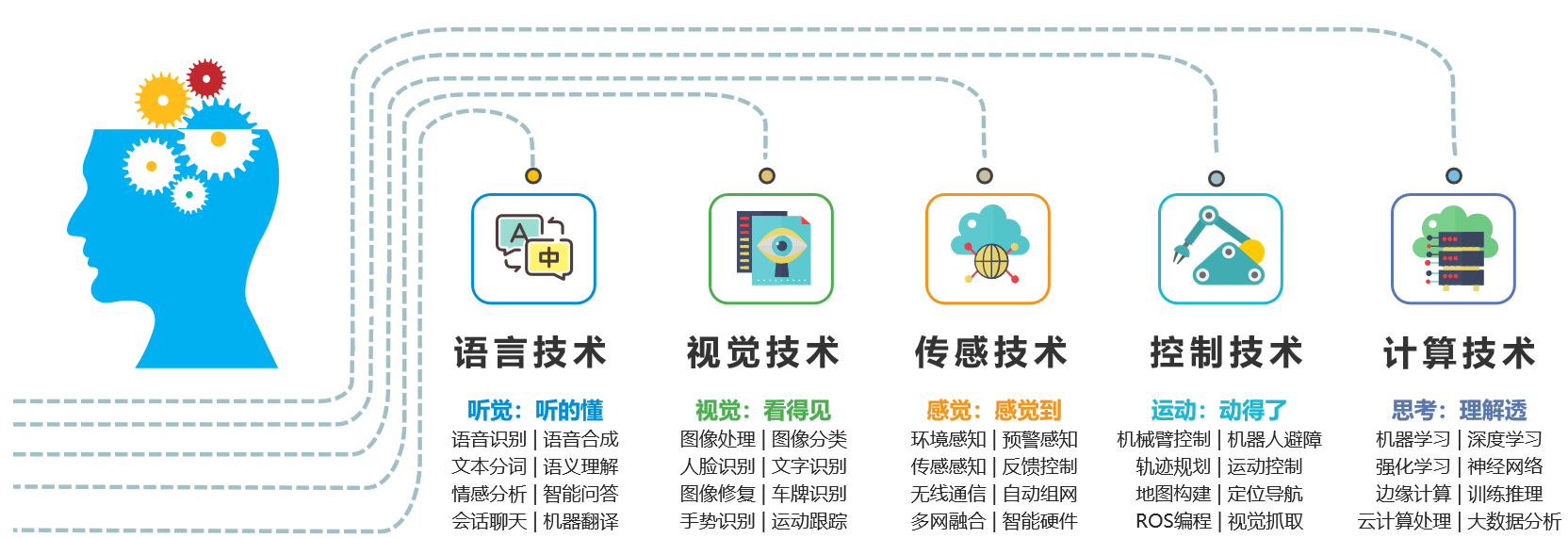

人工智能综合教学实验平台是面向高校人工智能相关专业推出的一款集科研教学、实验实训、项目实践于一体的综合性教学设备。平台采用云边端一体化设计理念,构建了行业主流的“端侧感知——边缘计算——本地应用——云端管理”的技术框架。边缘计算网关,采用NVIDA Jetson Orin Nano Super,提供1024个CUDA核心,最高支持67 TOPS AI算力;出厂预装多种人工智能开发环境,支持基于TensorFlow、PyTorch、百度飞桨等多种深度学习框架的模型训练和推理;本地化部署Deepseek等大语言模型,并实现与AI宽动态摄像头、麦克风阵列等硬件模块的深度融合,不仅实现了本地化的深度思考与推理,还实现了文本对话交流、语音对话与播报、图像检测与播报等多种大模型交互应用方式。

在端侧感知部分,平台同时搭载了机器视觉、自然语言处理、机器人三大AI智能硬件,并融合了无线传感网络、智能无线节点、端感知与控制模组(包含16种传感器和执行器)等IOT功能模块,实现了视觉、语音、环境信息等多种数据的实时采集,以及机械臂、电磁锁、舵机等多种执行器件的联动控制。在本地应用方面,平台通过17.3寸高清显示屏和Ubuntu操作系统,提供了猫狗识别、水果识别、人脸识别、交通标识识别、语音识别、垃圾分类、端感知控制等多种行业场景应用APP。在云端管理方面,平台通过MQTT协议和5G通讯,实现了机械臂的远程控制。

平台配套产品手册、实验指导书、电路原理图、硬件开发手册、软件开发环境、软件安装包、案例源代码等丰富的课程资源,涵盖编程语言、深度学习、计算机视觉、自然语言处理、机械臂控制、端感知控制、应用开发等完整的课程体系,为专业实验实训教学和项目实践提供全面支持。

2、平台特点

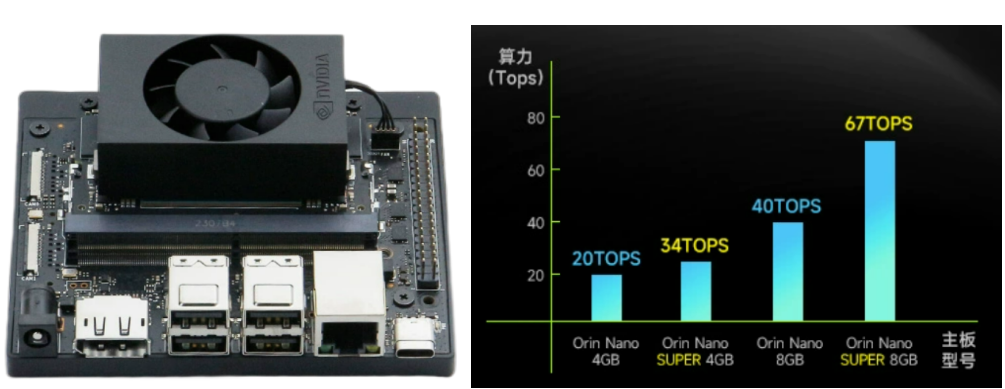

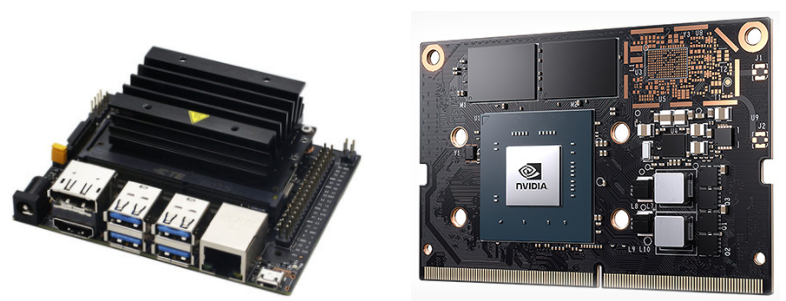

2.1、高性能边缘计算网关

平台采用NVIDA Jetson Orin Nano Super边缘计算网关,采用6核 Arm® Cortex® -A78AE v8.2架构,搭载1024个CUDA 核心和32个Tensor Core的NVIDIA Ampere架构,提供8GB 128-bit LPDDR5显存,最高提供最高67 TOPS的AI算力。出厂预装Ubuntu操作系统,集成Python3、深度学习、机器视觉、自然语言、ROS系统等开发环境,本地化部署Deepseek大语言模型,提供本地化深度学习和推理;

2.2、支持多种深度学习框架

平台支持TensorFlow、PyTorch、PaddlePaddle等多种深度学习框架,配套基于三种框架的深度学习3本实训指导书,提供从基础教学到案例应用的完整实验教学资源。

2.3、任意角度识别与堆叠

平台机器视觉处理单元内,支持任意角度准确识别多个视觉开发组件,配合机械臂支持在任意角度完成多个组件的夹取堆叠。对比于一些传统的人工实验设备只能在固定位置识别并夹取到固定位置,本平台更加贴近实际工业应用场景。

2.4、AIOT多场景应用

平台通过融合边缘计算、机器视觉、自然语言处理、深度学习、机器人等AI技术和无线传感网络、智能传感与控制等物联网技术,实现了智能家居、智慧安防、智慧交通、智能分拣等多种应用场景,并配套PyQT场景应用软件。

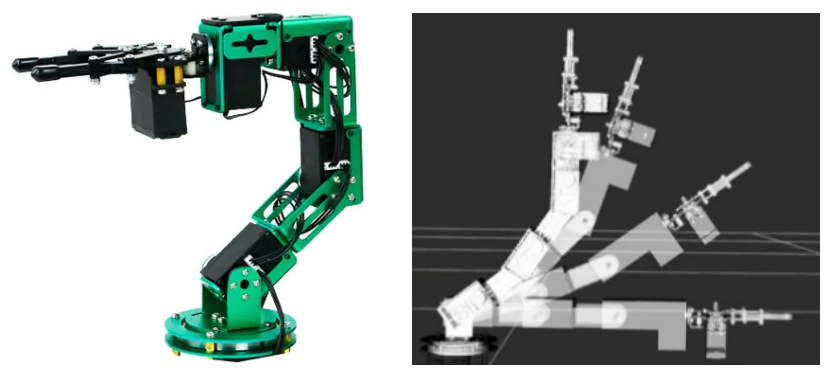

2.5、虚实结合以虚助实

平台配套人工智能虚拟仿真平台,利用图形化组件搭建的机械臂运动流程Python源代码,支持远程下载到人工智能真实硬件中,运行python代码文件,实现与虚拟仿真平台中一致的运动过程及结果。

2.6、配套丰富的课程资源

平台配套提供产品手册、电路原理图、软件开发环境、系统镜像文件、案例源代码、PPT课件、微课视频、实验指导书等丰富的实验课程资源,实验指导书涵盖《Python基础》《OpenCV机器视觉》《自然语言处理》《深度学习TensorFlow》《深度学习Pytorch》《百度飞浆paddle》《端感知控制》《六轴机械臂控制》《PyQT5应用开发》等9门实验课程.

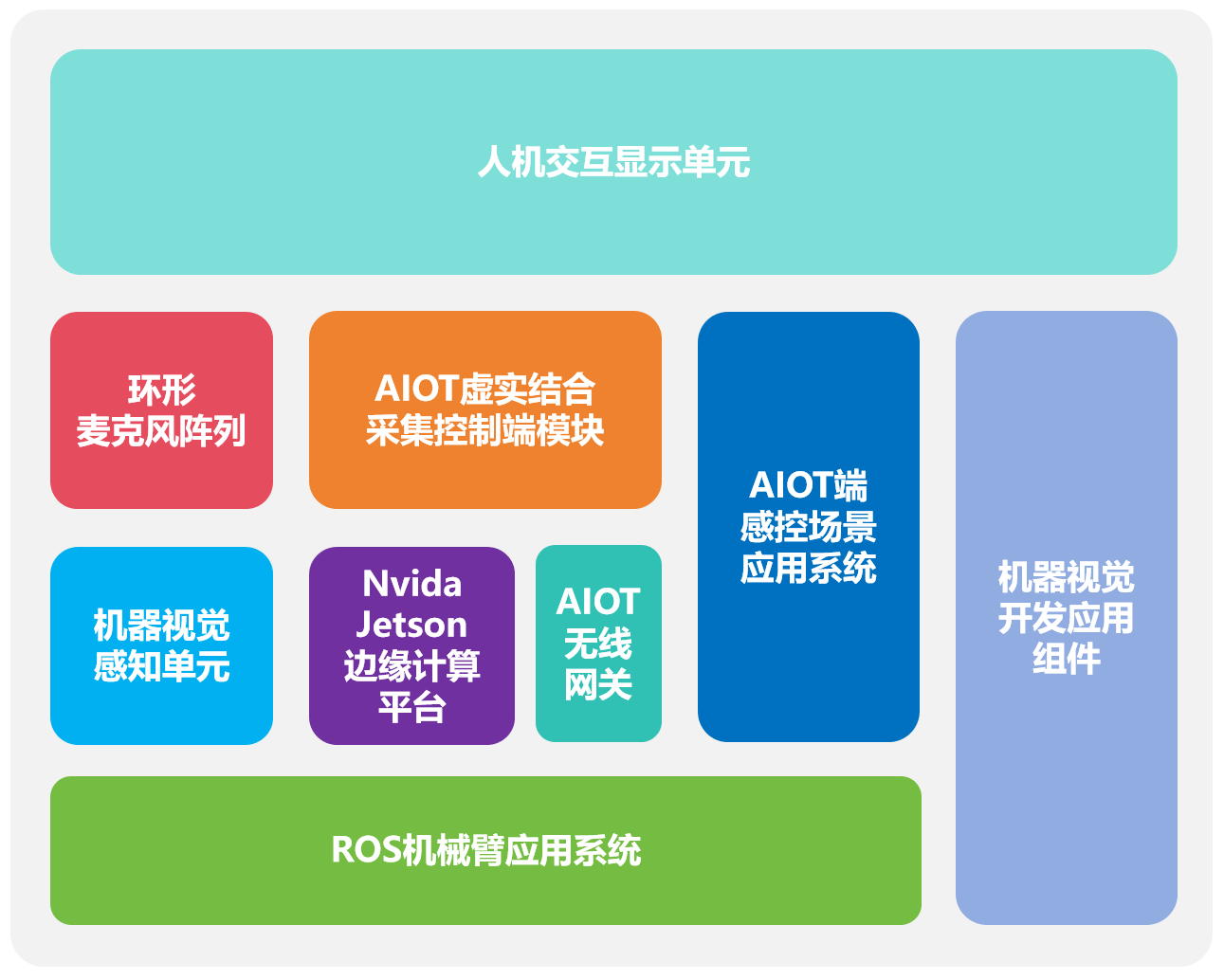

3、平台组成

平台主要由NVIDA Jetson Orin Nano Super边缘计算平台、人机交互显示单元、机器视觉感知单元、环形麦克风阵列、ROS机械臂应用系统、AIOT无线网关、AIOT虚实结合采集控制端模块、AIOT端感控场景应用系统、机器视觉开发应用组件等九大硬件单元组成。

搭载Ubuntu操作系统,配套颜色识别、猫狗识别、水果识别、人脸识别、车牌识别、目标识别、垃圾分类、语音识别、机械臂控制、端感知控制、云端控制等PYQT应用软件,共同组成软硬件一体、云边端协同的综合性实验平台。

3.1、边缘计算平台

NVIDIA Jetson Orin Nano Super是一个小巧却功能强大的计算机,它可以让你并行运行多个神经网络、对象检测、分割和语音处理等应用程序。搭载1024个CUDA核心和32个Tensor Core的NVIDIA Ampere架构,提供8GB LPDDR5显存,最高支持67 TOPS算力,并支持一系列流行的Al框架和算法,比如TensorFlow、Pytorch.caffe/caffe2、Keras、MXNET等。

3.2、人机交互显示单元

显示屏尺寸17.3 英寸,分辨率达到1920×1080,提供了清晰、细腻的图像显示效果。搭载Ubuntu操作系统,提供颜色识别、水果识别、人脸识别、车牌识别、垃圾分类、语音识别、端感知控制等应用软件。

3.3、机器视觉感知单元

搭载高清720P无畸变工业级摄像头,支持UVC(USB Video Class)免驱协议,配备金属外壳和支架。同时,提供USB 3.0 Type-A视觉接口,支持扩展乐视、奥比中光、英特尔等多个知名品牌的3D深度相机。

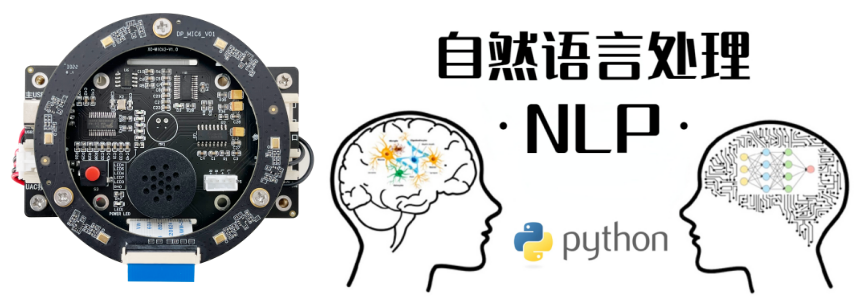

3.4、环形麦克风阵列

麦克风阵列采用四核Cortex-A53高性能边缘计算处理器和六麦克风环形阵列,阵列由6个麦克风环形排列组成,远场拾音实验室环境下可达10m,唤醒角度的分辨率为1°,可进行360°全方位声源定位。

3.5、ROS机械臂应用系统

视觉机械臂以Jetson Orin nano为主控,Open Source CV为图像处理库,以主流的Jupyter Lab为开发工具,使用Python3为主要编程语言。通过RO5机器人操控系统,简化了6自由度串行总线舵机复杂运动控制。通过与机器视觉的联合使用,实现颜色识别追踪与抓取,人体特征识别互动,以及垃圾分类模型训练垃圾分拣;平台配套的人工智能虚拟仿真平台,利用图形化组件搭建的机械臂运动流程Python源代码,支持远程下载到人工智能真实硬件中,运行python代码文件,实现与虚拟仿真平台中一致的运动过程及结果。

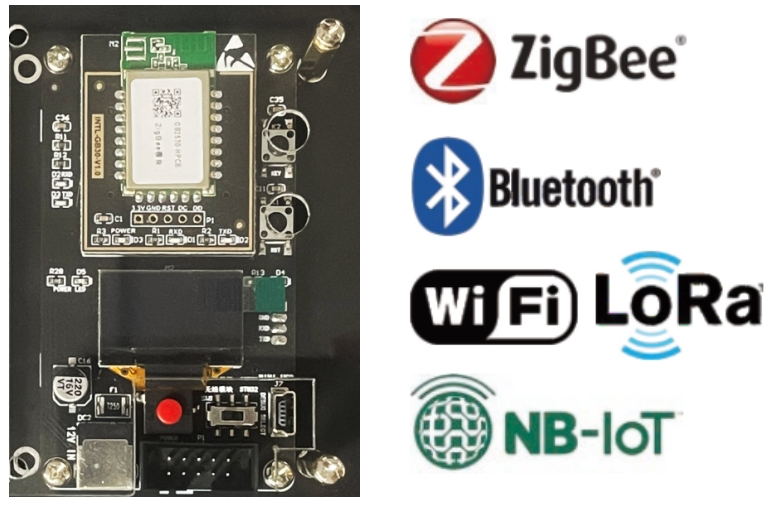

3.6、AIOT无线网关

采用Cortex-M3内核处理器,搭载0.96寸液晶显示屏;标配ZigBee无线模组,支持WiFi、BLE、LoRa等多种无线模组;

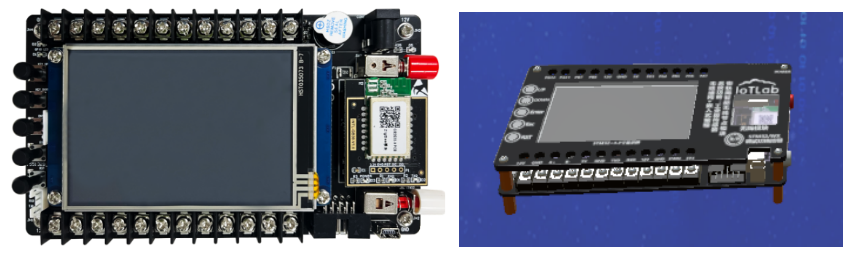

3.7、AIOT虚实结合采集控制端模块

采用Cortex-M3微处理器作为主控,板载3.5寸液晶触摸显示屏,预留1个无线模块插槽,支持插入Zigbee、蓝牙、Wifi、Lora等不同无线模组。提供IO、PWM、RS485和RS232串口等多种可编程接口,可用于连接各类工业级传感器或执行器;

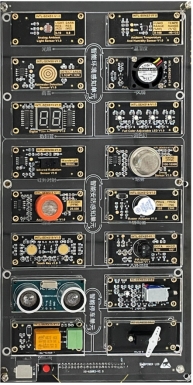

3.8、AIOT端感控场景应用系统

AIOT端感控场景应用系统,分为智慧环境、智慧安防、智慧停车三个实验单元。通过标准传感器、执行器接口,合计接入多达14种传感器和执行器。

序号 | 应用场景 | 传感器/执行器名称 | 图片 | 整体结构图 |

1 | 智慧环境 | 光照传感器 |

|

|

2 | 温湿度传感器 |

|

3 | 雨雪传感器 |

|

4 | 风扇 |

|

5 | 数码管 |

|

6 | 调色灯 |

|

7 | 智慧安防 | 红外对射传感器 |

|

8 | 烟雾传感器 |

|

9 | 酒精传感器 |

|

10 | 蜂呜器 |  |

11 | 人体感应传感器 |

|

12 | 触摸按键 |

|

13 | 智慧停车 | 超声波传感器 |

|

14 | 继电器 |

|

15 | 电磁锁 |

|

16 | 舵机 |

|

通过与AI宽动态摄像头、麦克风阵列等人工智能人机交互模块的联动,支持实现智能门禁、智能停车、智能家居等多种智能应用场景。

3.9、机器视觉开发应用组件

颜色标签:包含红色、绿色、黄色、蓝色四种颜色的色块或卡片,配套提供对应的训练模型数据;

商品模型:包含苹果、桃子、橙子、芒果等4个商品模型,配套提供对应的训练模型数据;

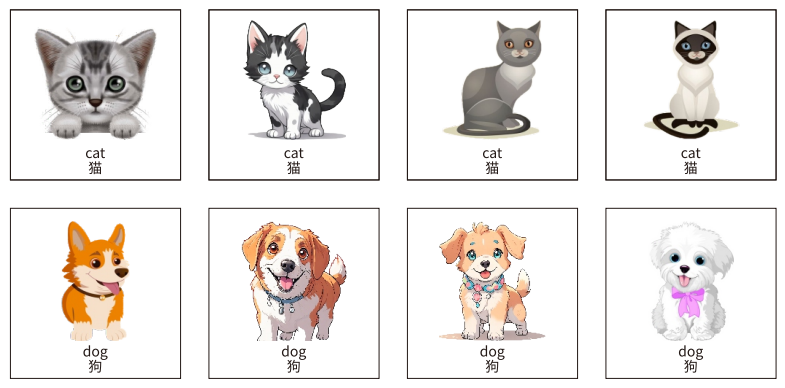

动物图卡:包含印刷有猫、狗等多种动物的物块或卡片,配套提供对应的训练模型数据;

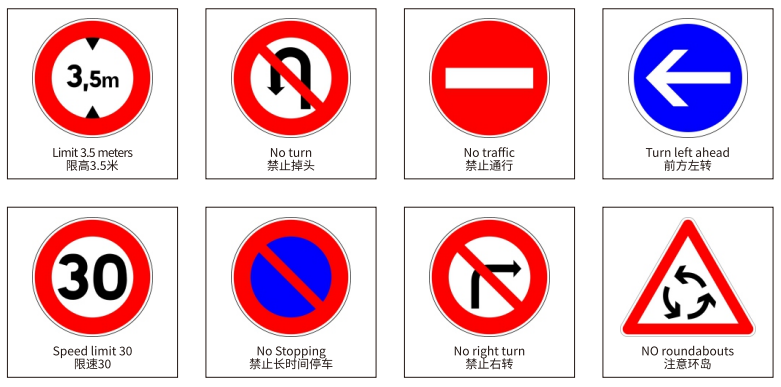

交通标牌:包含印刷有停车、转弯、限高、限速、禁止通行、禁止掉头等交通标识的物块或卡片,配套提供对应的训练模型数据;

垃圾物块:按照国家最新版《生活垃圾分类标志》标准,提供印刷有害、可回收、厨余、其他四类垃圾图标的物块,配套提供对应的训练模型数据;

4、软件功能应用

4.1、机器视觉应用

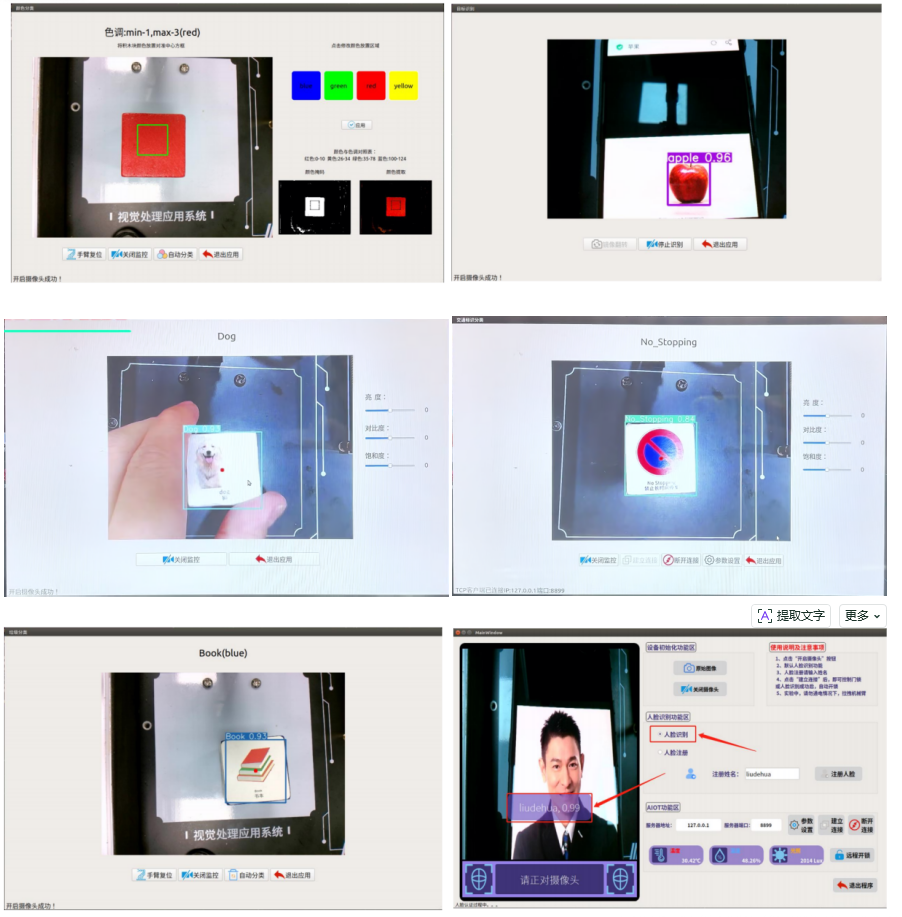

平台利用AI宽动态摄像头,可实现颜色识别、水果识别、宠物识别、人脸识别、车牌识别、垃圾识别、交通标识识别等计算机视觉应用,并提供PyQT软件功能应用。软件除了能显示目标名称外,还能实时显示目标与模型对比的相似度,还能在部分应用中通过语音播报识别结果。

在此基础上,视觉应用还能根据场景需要关联其他硬件,实现多种智慧应用场景的联动效果,如垃圾识别通过关联六自由度机械臂,可以实现垃圾分类应用。交通标识识别通过关联AIOT端感控场景应用系统下的调光灯、舵机、蜂鸣器等执行器、可以实现智能交管应用。人脸识别通过关联AIOT端感控场景应用系统下的电磁锁,可以实现智能门禁应用。

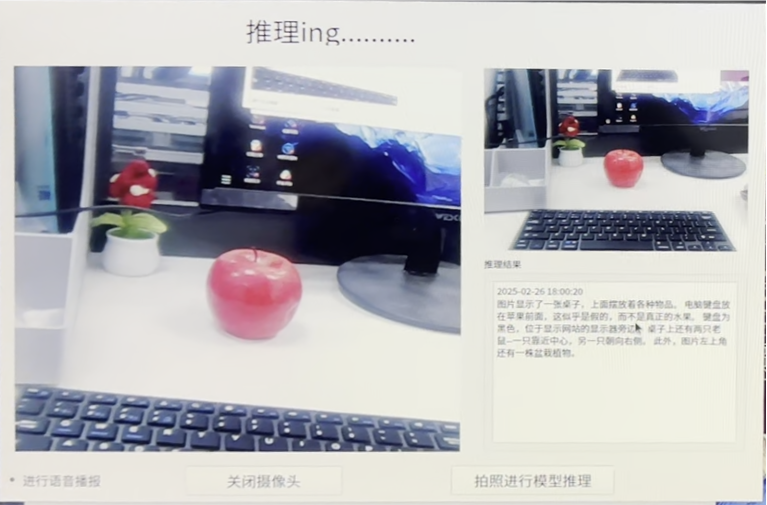

通过利用本地化部署的Deepseek大模型,平台还提供了环境物品任意识别应用,不仅能准确识别复杂环境中的物品名称和相对位置,还能通过语音播报识别结果。

4.2、语音识别应用

平台利用麦克风阵列,可以实现声源定位、语音唤醒、语音识别、语义分析等多种语音处理基础功能。结合AIOT虚实采集控制端模块、AIOT端感控场景应用系统,可以实现多种应用场景下的语音控制、语音合成、语音播报等综合性功能,贯穿自然语言处理完整流程。通过利用本地化部署的Deepseek大模型,语音识别应用还能通过语言对话,问询用户想要了解的任何问题,通过本地化的语义分析和推理后,最终通过喇叭播报回答结果。

4.3、端感知控制

平台利用AIOT端感控场景应用系统,可以完成环境监测、安防感知、智慧停车等三种应用场景下的端侧感知和端侧控制。同时,端感知控制还能与“传感器上云”应用,实现云端端感控应用。